STUGA1 – PROTOTYP 1 – JANA & MIRA

Tag 1 – Die Idee entsteht

Unser Team hat sich zum ersten Mal zusammengesetzt, um den Grundstein für unser gemeinsames Spielprojekt zu legen. Nach einer kreativen Brainstorming-Session stand das Grundkonzept fest:

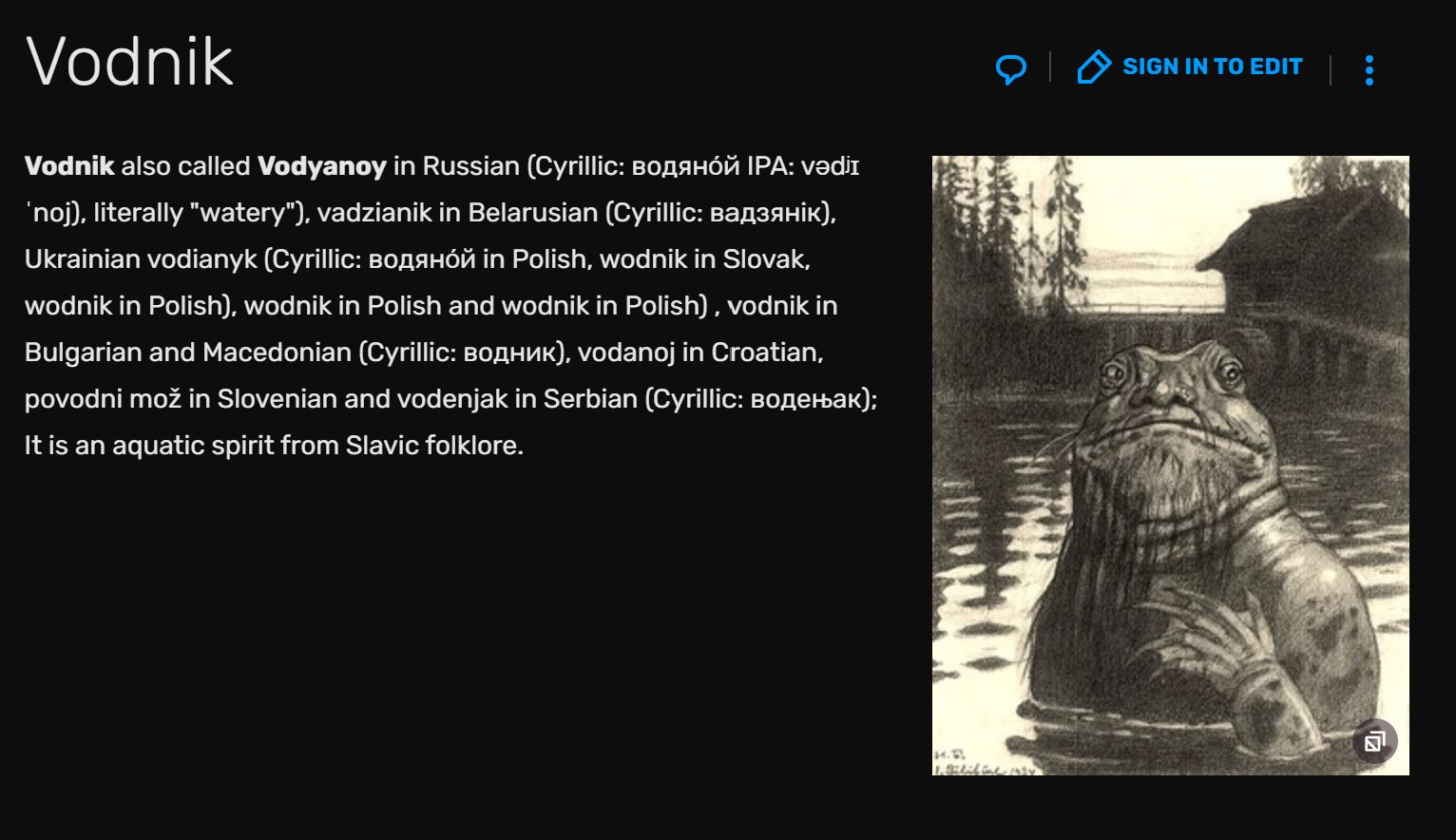

Man schlüpft in die Rolle eines frisch gestarteten Bloggers, der um die Welt reist, um zu beweisen, dass all die bekannten mythischen Wesen aus Urban Legends wie der Chupacabra, Slenderman oder der Mothman tatsächlich existieren. Seine Beweismethode: Selfies.

Das Ziel des Spiels ist es also, diese Kreaturen zu finden und sich selbst mit ihnen gemeinsam auf einem Foto abzulichten und die Beweise anschließend auf dem eigenen Blog zu posten. Damit war schnell klar: Die zentrale Spielmechanik wird das Fotografieren sein.

Tag 2 – Erste Schritte in Unity

Am zweiten Tag starteten wir direkt mit der Umsetzung. Da ich bisher keinerlei Erfahrung mit Unity oder Programmieren hatte, war mein erster Schritt, mich mit der Engine vertraut zu machen. Ich begann mit der Einrichtung einer First-Person-Kamera, um mich etwas einzufinden.

Anschließend implementierten wir die grundlegende Steuerung des Spielers, klassisch über WASD, damit man sich frei in der Welt bewegen kann. Parallel dazu begannen wir mit der Gestaltung des Spielercharakters und der Urban Kreaturen.

Ein wichtiger Moment war unsere Besprechung mit unserem Dozenten Sebastian Hollstein. Gemeinsam haben wir die Kamera- und Foto-Mechanik noch einmal durchdacht. Dabei entschieden wir uns, die Selfie-Funktion als Kernmechanik beizubehalten, anstatt auf klassische „Foto aus der Ferne“-Shots zu setzen.

Das Besondere dabei: Wenn der Spieler in den Fotomodus wechselt, kann er sich nicht mehr bewegen. Die Herausforderung liegt darin, das sich bewegende Monster dennoch irgendwie ins Bild zu bekommen. Man kann die Kamera sowie den Spieler selbst nach links, rechts, oben oder unten neigen, um den perfekten Winkel zu finden. So entsteht ein dynamisches, leicht chaotisches, aber sehr spaßiges Gameplay, ähnlich wie beim echten Selfie-Machen in Bewegung.

Da man im Selfie-modus den Player auch sieht, haben wir uns in Blender zuerst an das Modellieren von unserem Blogger gemacht. Die Motivation war gross, unseren Character schön zu sculpten, doch dass war für unseren Zeitplan kein effizienter Vorgang. Daraufhin haben wir den Style gewechselt und alle Figuren in einer simpleren Geometrie aufgebaut. Das hat schlussendlich ganz gut zu unserem Prototyp gepasst.

Tag 3 – Fotografieren & ein bemühter NPC

Nun war es an der Zeit, mich an die Hauptmechanik des Spiels zu machen: das Fotografieren.

Als erstes haben wir eine Funktion eingebaut, mit der man per Key Input zwischen zwei Perspektiven wechseln kann. Der normalen Frontalansicht und einer „Selfie-Perspektive“. Damit der Spieler auch versteht, dass es sich hier um die Kamerafunktion handelt, haben wir in Photoshop ein simples Kamera-Overlay gebastelt, das wie eine Art Sucher wirkt.

Dann kam der wichtigste Teil: mit der Leertaste kann man nun ein Live-Ingame Foto machen. Technisch funktioniert das so, dass alle Pixel des gerade sichtbaren Screens abgegriffen und als Bild wieder angezeigt werden.

Zusätzlich haben wir dafür gesorgt, dass der Spieler sich nicht mehr bewegen kann, während er im Selfie-Modus ist. Das macht das Ganze nicht nur realistischer, sondern sollte (theoretisch) auch der Game-Aspekt sein, der dem Spieler spass macht (Spoiler: It kind of didn’t really work :[ )

Design-Technisch haben wir den NPC modelliert und mit Hilfe von Mixamo eine witzige Rennanimation gemacht. Hier mussten wir uns mit dem Export und Import von Blender zu Mixamo und Unity auseinandersetzen und noch einige Anpassungen im Model und Material machen, damit das Model richtig exportiert wird. Beim Import in Unity gab es jedoch noch einen grafischen Fehler mit dem Material des NPC. Er sieht nun an einigen Stellen etwas glänzend und durchsichtig aus.

Tag 4 – Endspurt

Am letzten Tag haben wir noch einige Assets (Bäume, Büsche und Felsen) gemacht und diese in einem neuen Level platziert.

Nachdem die Kameramechanik stand, haben wir uns an den NPC (aka den Monsterfrosch) gewagt. Das stellte sich als deutlich schwieriger heraus, als gedacht.

Unser erster Ansatz war über NavMesh Maps und NavMesh Agents. Aus unbekannten Gründen wollte das Ganze aber einfach nicht so funktionieren, wie es sollte. Also haben wir, aufgrund eines Inputs von Dragica, einen zweiten Ansatz mit Raycasts ausprobiert.

Das Ergebnis: so halb erfolgreich.

Es gab mehrere Probleme:

-

Einerseits konzeptionelle Fehler, die wir nicht sofort verstanden.

-

Andererseits Aufmerksamkeitsfehler, wie etwa, dass ich den NPC direkt mit

transform.positionbewegt habe. Dadurch hat er natürlich sämtliche Collider ignoriert, ist fröhlich durch Wände gelaufen und schließlich sogar aus der Map gefallen. -

Mit den Raycasts war er dann zwar in Bewegung, aber eben mehr am Herumzittern und Flackern, weil die Abstände zu eng gewählt waren und die Richtung ständig neu berechnet wurde.

Das größte Problem kam dann aber als plötzlich die Fotomechanik nicht mehr funktionierte. Nach längerem Debuggen stellten wir fest, dass wir einfach Code in das falsche Script geschrieben hatte, Visual Studio Code war mit seinen vielen Tabs nicht mehr so übersichtlich (oder besser gesagt: ich(Mira) war schuld, weil ich den Überblick verloren hatte). Bis das wieder korrigiert war, war die Zeit schon knapp, und am NPC konnte nicht mehr viel verbessert werden.

Fazit

Die Kamera funktioniert schon ziemlich stabil, man kann Perspektiven wechseln, Fotos machen, und der Selfie-Modus finden wir persönlich ziemlich cool. Der NPC hingegen ist aktuell noch eher ein experimentelles Wesen. Er versucht sich zu bewegen, stolpert ein bisschen durch die Gegend und bleibt gerne mal hängen. (pls accept him, he’s trying🐸)

https://habbathejutt.itch.io/creature-photographer